DLsiteとFANZAの同人音声作品を題材とした探索的データ解析

はじめに

(注意: この記事はいたってまじめな内容ですが、取り扱っている分野ゆえアダルトな表現やサービスへのリンク等が含まれます。気を付けてね!)

同人音声とは、個人あるいは小規模な団体によって製作される音声作品のことです。

ネット販売の普及で個人が手軽に参入できるようになってからの同人作品市場の発達は、目を見張るものがあります。同人音声もその例に漏れず、発表作品の量・質ともに向上を続けています。

ところで、アダルトコンテンツのデータ解析はいろいろなところで行われており、例えばPornHubはPornHub Insightsで様々な面白い調査を公開しています。

例えば、下はハロウィン期間中の検索ワードやトラフィックの変化とかの可視化。インフォグラフィックとしてめちゃくちゃ見やすいので、おすすめです。

日本では、2018年に公開された「FANZA REPORT 2018 同人編」が有名です。FANZA同人に訪れたユーザー約1億4000万人の調査が行われ、「寝取り・寝取られ」が圧倒的人気ジャンルであることが一部界隈で話題となったりしました。

これらの調査は訪問ユーザーを対象としたものが中心ですが、コンテンツの供給側(同人サークル)を対象として、作品のダウンロード数に注目した調査はこれまでに行われてきませんでした(たぶん)。

そこで本記事では、FANZAおよびDLsiteで販売されている同人音声の探索的データ解析(EDA)を行います。

素人のお遊びですが、お楽しみいただければ幸いです。

わかったことを3行で

- 同人音声の市場は年々増大。DLsiteでは9件/日のペース。

- DLsiteでは癒し系、FANZAでは女性上位系が特に人気。女体化はどっちでも人気。

- FANZAのユーザーには性癖トガリネズミが比較的多い。

収集対象

FANZA同人、DLsiteで公開されているすべての同人音声を対象に、以下の情報を収集しました。取得日時はばらばらですが、おおむね11/25~27の間です。

- タイトル

- 販売価格(定価)

- 総ダウンロード数

- 販売期間

- ジャンル・タグ

データの取得にはPythonのBeautifulsoupを使いました。

ダウンロード数および価格の分布

データを取得した同人音声の総数は、それぞれ以下のようになりました。

DLsite: 16434件

FANZA: 12047件

はえーすっごい数。

同人音声の取り扱い総数はDLsiteの方が4000件ほど多いみたいです。

このデータをいろいろな側面から見ていくことにします。

年度別の同人音声販売数推移

まずは、販売数が年ごとにどのように移り変わっていったのかを見てみます。

どちらも右肩上がりに増大していますね。DLsiteの販売数は11/27で既に3000件を超えています。おおよそ、FANZAでは6件/日、DLsiteでは9件/日のペースで作品が公開されている計算になります。

自分が同人音声を聞き始めたのは2014~15年あたりなんですが、そのころと比べると販売数は2倍以上です。

すごい量だ。

ダウンロード数の分布

では次に、ダウンロード数の可視化をしてみましょう。同人サークルの方々からすると気になる内容かもしれません。

まずは普通にヒストグラムを作ってみましょう。

ダウンロード数が低い(0~200)作品が全体のほとんどを占めることがわかりますね。

ちょっとみにくいので、ダウンロード数の対数を取ってヒストグラムを書き直してみましょう。

はい、どちらもきれいな釣り鐘型のヒストグラムになりました。

つまり、ダウンロード数の分布は対数正規分布で表せることが期待されます。実際この分布は、各人の年収が従う分布であることが知られており、まあ妥当です。

中央値を計算するとDLsiteが240、FANZAが75.0となりました。ダウンロード数の多い順に順位をつけていった場合に、ちょうど中間の順位となる音声のダウンロード数がこの値と一致します。

同人音声のプラットフォームとしての規模は、DLsiteの方が大きいと言えそうです。

販売価格の分布

次は販売価格の分布をみていきましょう。

当然と言えば当然ですが、販売価格の分布に大きな違いはありません。が、DLsiteの場合、きわめて低価格(無料~250円)の範囲で度数が大きくなっているのが気になると言えば気になります。

平均価格はDLsiteで885円、FANZAで1002円となりました。定価で比較すると、FANZAのほうがやや高めです。もちろん、割引やポイント還元等のキャンペーンもあるので、どちらがお得かは一概には言えませんが。

作品ジャンル(タグ)の解析

基本的な統計

FANZAおよびDLsiteいずれの場合も、作品のジャンルを端的に表現するためのタグがつけられています。

まずは、タグの種類をそれぞれ数えてみます。

DLsite: 330件

FANZA: 295件

まあだいたい300件ぐらいですね。

ちなみにタグの使用数ランキングは、以下の通りです。

DLsite

- フェラチオ:4247件

- 淫語:3351件

- 癒し:3232件

- ラブラブ/あまあま:2861件

- 中出し:2816件

- フェラ:4891件

- 中出し:3280件

- オナニー:2646件

- 言葉責め:2044件

- ラブラブ・あまあま:1896件

FANZAのデータからは、男性向け、成人向け、音声付き、体験版ありなどのタグを解析の対象から外しています。面白くないからね。

同人音声で最も使われているタグは"フェラチオ"のようです。確かに成人向けであればたいてい入っているような……。

ジャンルごとの同人音声の購入数(DL数)比較

ユーザー間での人気ジャンルを推定するためには、同人音声の音声のタグごとにダウンロード数を比較してみればよさそうです。

たとえば、DLsiteの人気タグ上位3つ(フェラチオ, 淫語, 癒し)を有する作品のダウンロード数の分布は以下のようになります。

赤の点線はダウンロード数の中央値で、それぞれ227,213,345となりました。

さて、この中央値で比較して、最も多くダウンロードされているタグは何でしょうか?

全部のヒストグラムを書くのも大変なので、使われる頻度が高い100個のタグのうちから、ダウンロード数の上位20タグを箱ひげ図で表してみました。

こちらの解析では、まず使用される頻度が高い100個のタグを用意してから、そのうちでダウンロード数の中央値が高い順に箱ひげ図を20個並べています。

縦軸がジャンル名、横軸がダウンロード数(対数)を表しています。箱の中のオレンジ色の線の位置が分布の中央値を表していて、その値はタグ名のとなりのカッコ内に表示してあります。

DLsiteでは耳舐め、ささやき、バイノーラル等のタグがダウンロード数の上位にあります。一方で、FANZAでは逆転無し、脚、色仕掛け等のタグが目立ちます。

どうやら、DLsiteのユーザーは癒し系、甘やかし系が、FANZAのユーザーは女性上位系の同人音声が好みのようです。

また、両方を見比べてみると、どちらも性転換・女体化がそれぞれで上位にランクインしていることがわかります。作品数は多くない(どちらのサイトでも170件程度)ですが、ニッチな人気があるジャンルのようです。

同人音声のプラットフォーム別販売数の解析

プラットフォームごとのダウンロード販売数の比

最近の同人音声は、DLsiteとFANZAの両方で販売されることが多いです。

この両方のプラットフォームに同じタイトルで販売されている同人音声の数は、5231件にも上ります。

この同人音声それぞれにおいて、プラットフォームごとのダウンロード販売数の比(DLsite/FANZA)をヒストグラムで表すと以下のようになります。

赤の点線は比率1を表しており、ここから右がDLsiteのダウンロード数が多い領域、左がFANZAでのダウンロード数が多い領域です。

FANZAの方が販売数の多い同人音声の割合は、2.58%となりました。

また、ダウンロード数比の中央値は3.43となりました。

プラットフォームとジャンルごとのダウンロード数の関係

では、ジャンルごとのダウンロード数比の偏りはどうなっているでしょうか。

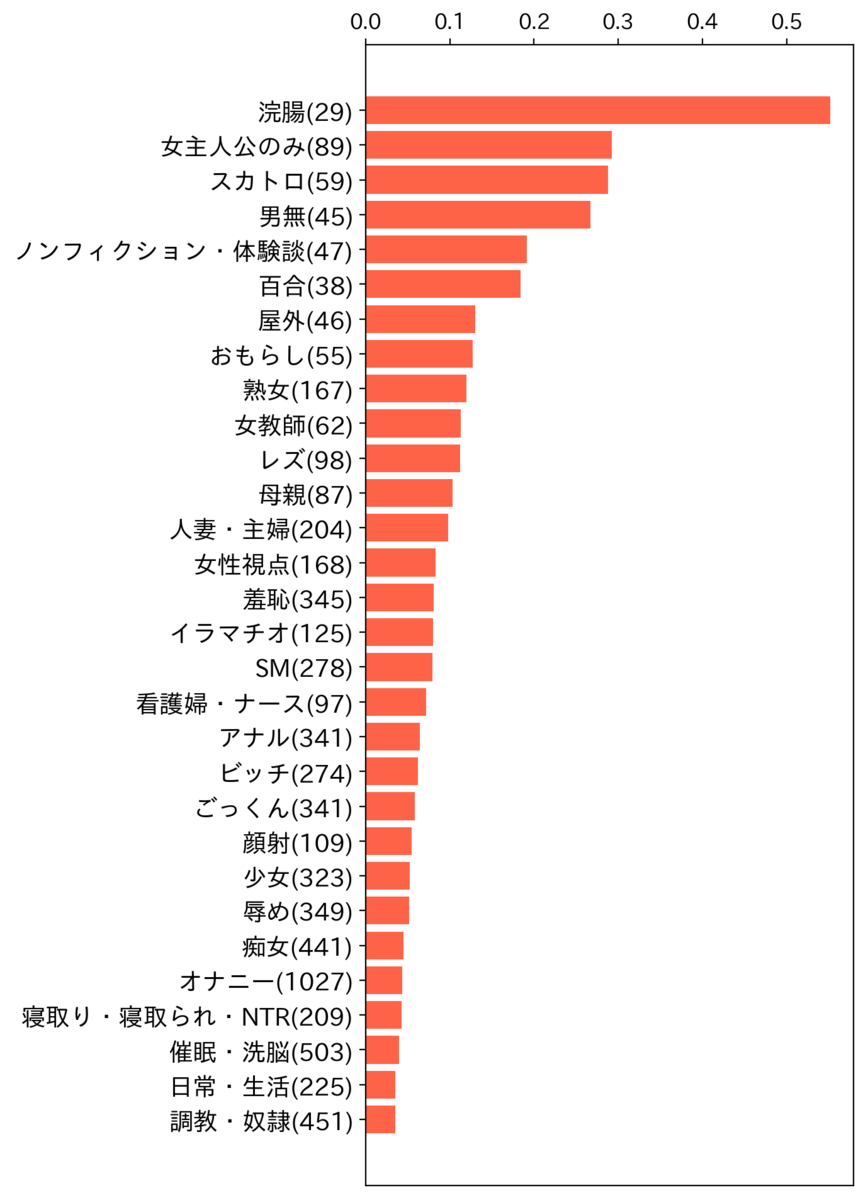

音声作品のダウンロード数がFANZA > DLsiteとなるジャンルの割合を計算し、上位30位を並べてみたものが以下になります。(タグの表記はFANZAのものに準じています)

かっこの中は各ジャンルのタグを付けられた音声の総数、横軸はFANZAの販売数の方が多い音声の割合です。

例えば、FANZAで販売されている浣腸とタグ付けされた音声は、その半分以上がDLsiteのダウンロード数を上回っていることがわかります。

……多すぎない?

しかもなんか尖り気味の性癖が多いですね。スカトロとかおもらしとか……。

基本的にはニッチなジャンルのほうがFANZAでは売れやすいみたいですね。

DLsiteのタグとFANZAのタグは一致していないので、相互の比較は手動での関連付け(例: レズ/女同士(DLsite) ↔ 百合(FANZA))が必要です。

気になった10個のタグについて相互に関連付けを行い、ダウンロード数をそれぞれ箱ひげ図で表示した結果が以下のようになります。

青色がDLsiteの、赤色がFANZAのダウンロード数の分布を表しています。程度は種類により異なりますが、浣腸を除くすべてのジャンルでDLsiteのダウンロード数がFANZAを上回っています。

調査のまとめ

- 同人音声の販売数は、どちらのプラットフォームでも年々増加しており、2019年現在では、FANZAで約6件/日、DLsiteで約9件/日のペースで作品が公開されている。

- 同人音声販売プラットフォームのとしての規模は、DLsiteのほうが大きい。ダウンロード数の中央値はDLsite, FANZAでそれぞれ240,74となった。

- ジャンルごとの同人音声のダウンロード数をプラットフォームごとに比較すると、DLsiteでは癒し系、甘やかし系が、FANZAでは女性上位系のジャンルがよく購入されていることがわかった。また、性転換・女体化のジャンルは、どちらのプラットフォームでも非常に人気がある。

- 2つのプラットフォームをまたいで販売されている同人音声のみに絞って、ダウンロード数の比とジャンルの関係を調査した。その結果、FANZAではニッチなジャンル(特に浣腸)がDLsiteよりも多く購入されていることがわかった。

最後に

調査の動機と今後の展望

同人音声には日々お世話になっているということもありますが、何よりもDLsite, FANZAのどちらでも作品のダウンロード数が公開されていることが一番の要因でした。

商品の販売数がリアルタイムで公開されていて、しかもタグ付けもしっかりされている大量のデータとか、めちゃくちゃ貴重です。

サークルごと、声優ごとにダウンロード数や価格を見ればランキング的なのも作れそうです。今回はやりませんでしたが。

継続的にダウンロード数のモニタリングしてみると、日別のダウンロード数の増減や、休暇やクリスマス中の傾向とかが見れて面白そうです。

その他にやったこと

タグの共起関係をネットワーク図に書いて遊んだりしました。

この図からは、たとえば言葉攻めとタグ付けられた音声には、逆レイプ、痴女、逆転無しといったタグが一緒につけられやすいことがわかります。

いずれこれを使って何かやるかもしれません。

DLsiteの購入履歴から性癖の尖度、歪度を判定するやつとか作れそう。どちらも購入リストをオープンにすることはできないので、いわゆるアプリとしての実装は無理そうですが。

最後に、最近買ったなかでお気に入りの作品を貼っておきます。

それでは。

konkon

『食べログ独自の評価基準』の機械学習による再現を試みる

はじめに

以前の記事に関しては本当にたくさんの反響があり、多くのコメント・ご指摘をいただきました。皆様ありがとうございます。

この問題の経緯から詳細まで、総まとめの記事がYahooニュースに上がっていたので、ここで紹介しておきます。

https://news.yahoo.co.jp/byline/inoueakito/20191012-00146614/

この記事(とそれに先行した解析)では、口コミ総数が100以下の店舗も収集対象にしています。さらに、口コミ件数で足切りを行うことで、評価点数の分布に壁(上限)が生じることを示しています。

以上の結果から、食べログが行っているであろう点数の操作はいわばスパムフィルター的なものであり、点数操作の不正に対処するためのアルゴリズムでなのではないかと述べています。めちゃくちゃ納得しました。

これでこの問題も終わり!

(前略)ここで問題にしたいのは、つまり、公開データをもとに、ある程度まで食べログ点数を算出する近似計算ができたのなら、食べログは不正をしていない可能性が十分にあるということをある程度まで示せるだろうということです。食べログ内で公開されているパラメーターを可能な限りすべて取得して、Deep learning的なものに放り込めば、公開情報をもとに食べログの公正性を検討することは可能かもしれません。

…と思っていましたが、機械学習の練習がてら食べログ評価基準の再現をやってみることにします。

(ただし、Deep Learningは使いません)

前置き

今回の目的は『食べログが不正をしているかどうかを検証する』ことではありません。

本記事の目的は、ネット上で公開されているデータだけから、食べログの評価点を再現する機械学習モデルを構築することです。

収集対象となる店舗の設定

以前の記事で収集した、全国47都道府県のレビュー総数100以上の店舗6852件、加えて前回収集を忘れていた埼玉の139件を加えた総6991件から機械学習のデータを収集します。(コメントでのご指摘ありがとうございました)

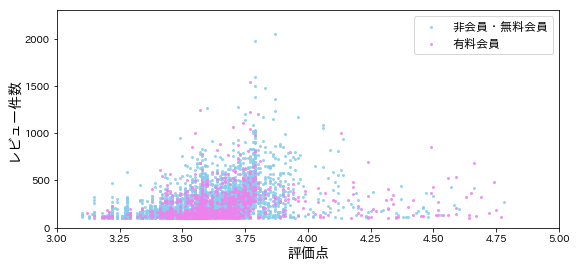

この全店舗の評価点と、レビュー件数をプロットしたものが以下になります。

このうちの一部、1980店舗を機械学習に用いました。一部に分けた理由は、全部取ってくると3.50~3.75あたりにデータが密集してしまうからです。あと、新しく収集するのがめんどくさかった。

実際に収集するデータの分布は以下の通りです。

収集するデータはその店舗を対象とした全口コミと、口コミを投稿したユーザーの情報(過去の投稿数,フォロワー数)、および投稿日時です。

収集したデータの確認

ユーザー評価のヒストグラム

機械学習に移る前に、収集したデータの確認をします。

まずは、ユーザー評価点の分布です、食べログ評価点の分布とどのように異なっているでしょうか。

0.1点刻み(ユーザー評価の最小単位)で作成したヒストグラムは以下のようになります。

左がランチの評価、右がディナーの評価です。それぞれの評価の総数はランチが494336、ディナーが50133件です。

まずわかるのは、0.5点刻みでレビュー件数がけた違いに増えることです。食べログユーザーは、明らかにキリのいい点数をつけたがる傾向にあります。その気持ちわかる。

0.5点刻みの部分だけを見れば、ユーザー評価は低評価側に裾が重いものの、正規分布のように見えます。しかし、0.1点刻みで見てみると、食べログ評価のヒストグラムに類似した3.8点付近の壁があることもわかります。

(今は2つに分けましたが、今後はディナーとランチの評価は平均を取ってユーザーの点数とします)

ユーザー評価平均と食べログ評価点の差異

食べログでは、店の評価はユーザー評価の平均ではないことが公式から発表されています。

では、実際にどのくらい違うのでしょうか。収集したデータから可視化してみます。

Y軸がユーザーの平均評価点、X軸が食べログの評価点、そしてプロットの色が評価の総数を表しています。

この図では、右上へ延びる直線に近い点ほど、点数の誤差が小さいことを示しています。食べログ評価と平均評価点の平均絶対誤差は0.1168、二者の相関を表す決定係数(R2)は0.6509となりました。

また、誤差の分布はほぼ対称的であり、特に食べログの評価点がどちらかに寄る、といった傾向はないことが分かります。このことは、誤差の分布を見ることではっきりします。

誤差の分布は、0を中心とした対称な分布となっています。

また、FIg. 4の色に注目すると、食べログ評価点3.7あたりを境にユーザー評価件数が増加していることが分かります。これは、前述の記事で示されている口コミ数に対応したフィルターの存在を示唆しています。

各店舗の特徴量抽出

それでは、収集したユーザ評価と、対応したユーザーの過去の投稿数と投稿日時を用いて、店舗ごとの特徴量を作成していきます。

上の図は、ある店舗のユーザー点数と、対応したユーザーの過去の投稿数の分布です。点線はそれぞれ食べログの点数とユーザーの平均点数を表しています。

店舗を代表する特徴量を、過去の口コミ投稿数が多いユーザーの評価がより優先的に反映されるようにするため、ユーザーの過去の投稿数の重みつき平均化を用いて以下のように作成します。

- 各点数(0.1刻み, 40個)において、ユーザーの過去の投稿数を重みつき平均化する。

- 平均化した値に、その刻みにおける総投稿数を掛ける。

- 値の範囲が[0,1]の間に収まるように正規化する。

以上の方法で作成した特徴量を重ねてプロットした図を以下に示します。

この処理を、対象となる1998店舗すべてに行い、特徴量として重み付きの平均投稿数を得ます。以下に、例として25の店舗の分布を示します。

さらに、同様の処理をレビューの新規度(投稿してからの経過日時の逆数)に対しても同様に行います。こちらも最小で1、最大で0となるように正規化します。

ここで、重み付き平均を用いた特徴量は値を正規化しているため、口コミ投稿数の情報が入っていません。

そこで、投稿数を正規化したものを末尾に加えて、合計81次元(40+40+1)のベクトルを作成します。店舗No. 1778の場合、このベクトルは以下のようになります。

この特徴量ベクトルを1998個作成して機械学習に用いました。

機械学習による食べログ評価モデルの再現

Fig.4, Fig.5の辺りではユーザー評価の平均値と食べログ評価値を比較し、平均絶対誤差は0.1168、決定係数(R2)は0.6509となることを示しました。

今回は、この誤差を基準とし、機械学習によってどれだけ食べログ評価に近づけられるかを検証します。

機械学習のモデルには、決定木をベースの分類器としたAdaBoostを用いました。手法に関して詳しくは以下を参照してください。学習にはPythonのscikit-learnを用いています。

Decision Tree Regression with AdaBoost — scikit-learn 0.21.3 documentation

準備したデータは学習用データとテストデータに8:2で分割し、グリッドサーチで簡単なパラメータ最適化を行いました。その結果得られたパラメータは以下のように なります。

{'base_estimator': DecisionTreeRegressor(criterion='mse', max_depth=6), 'learning_rate': 1.5, 'n_estimators': 400}

この条件で学習を行った結果を以下に示します。テストデータに対する食べログ評価値の予測結果です。

ユーザーによる点数の平均が青色で、機械学習による予測がピンク色でプロットされています。明らかにユーザー平均よりも誤差が小さくなっていることが分かります。

点数が高い部分(>4.0)ではあまり予測ができてないように見えますが、これはデータ点が少ないことが原因だと思われます。データ収集の時点で低評価側をある程度絞ったのですが、それでも少なすぎました。

以下に、テストデータ(396店舗)の平均絶対誤差と決定係数を示します。

| ユーザー平均 | 機械学習による予測値 | |

|---|---|---|

| 決定係数(R2) |

0.6550

|

0.8313

|

| 平均絶対誤差(MAE) |

0.0672

|

0.0464

|

機械学習にはあまり明るくないのではっきりしたことは言えませんが、そこそこ良くなったのではないでしょうか?

最後に、ヒストグラムの比較を載せておきます。

機械学習による予測は、ユーザー平均と比較して食べログ評価と似たようなヒストグラムになっています。しかし、3.8点辺りの分布の変化と、3.6点での数の増大は再現できていないように見えます。

まとめ

まず、食べログに記載されている店舗の口コミをそれぞれ収集し、その評価点と投稿ユーザーの過去の投稿数、投稿日時、および総口コミ数を用いて店舗ごとの特徴ベクトルを作成しました。

そしてその特徴ベクトルを用いて機械学習を行い、いわゆる『食べログ独自の評価基準』による採点を再現することを試みました。

その結果、ユーザーの平均評価よりも、食べログ評価に近い点数を再現する予測器を作ることができました。

しかしながら、話題になったような食べログ評価の特徴的な部分、3.8点で減り3.6点で増えるような分布を再現することはできませんでした。今後の課題です(やらない)。

最後に

ちなみに、教師データとして与える店舗ごとの特徴量ベクトルに、その店が有料会員か否かの情報を与えることもできます(非課金 ⇒ 0, 有料会員 ⇒ 1 といった感じ)。

この会員情報を入れた時と入れなかった時の予測器の性能比較は以下の通り。

| ユーザー平均 | 予測値(会員情報なし) | 予測値(会員情報あり) | |

|---|---|---|---|

| 決定係数(R2) |

0.6550

|

0.8313

|

0.8357

|

| 平均絶対誤差(MAE) |

0.0672

|

0.0464

|

0.0458

|

ちょっとだけよくなりましたが、ほとんど変わりません。MAEで見ると0.001ぐらいです。食べログ評価点の刻み幅は0.01だからこの差は見えません。

この結果だけから断定することはできませんが、店舗がお金を払っているかどうかは、やっぱり食べログ評価を定めるにあたって重要な特徴ではなさそうです。

具体的に課金の有無が点数に及ぼす影響に関してはこちらで詳しく調べられています、気になる方は参照してください。

もっと教師データの量を増やしたり、店舗を代表するデータの種類を増やしたり、特徴量の取り方を工夫したり、予測器の性能を上げる余地はたくさんあると思いますが、根詰めてやることでもなさそうなのでこれぐらいにします。

konkon

データ解析を駆使して食べログ3.8問題が証明できなかった話

(2019/10/12追記 データ解析のプログラムもGitHubで公開しました)

(2019/10/15追記 会員の見分け方に誤りがありました。本文中では"非会員"と"有料会員"に分けると述べていますが、正確には"非会員・無料会員"と"有料会員"に分かれています。以後の図・文章は脳内で変換していただけると幸いです。詳細は https://anond.hatelabo.jp/20191011180237 で他の方が調べてくださっています)

はじめに

この記事は、藍屋えん氏( @u874072e )の以下のブログに触発されて、個人的に行った一連のデータ解析をまとめたものです。

clean-copy-of-onenote.hatenablog.com

上のブログでは、食べログ3.8問題と称される問題、

「評価3.8以上の店舗は年会費を払わなければ評価を3.6に下げられる」

との説を食べログの店舗データの解析により検証しています。

(存在が証明されたわけではないため、今後は食べログ3.8仮説と呼ぶことにします)

ブログ上で挙げられているヒストグラムは、評価点の分布に明らかに偏りがあることと、評価点3.6付近にピークが存在することなどから、この問題の存在を示しているように思えます。

このブログに触発され、私も、藍屋えん氏と同様に食べログ上の店舗評価を収集・解析して食べログ3.8仮説の検証を行いました。

あらかじめ言っておきますが、本記事では、食べログ3.8仮説は証明できないということを最終的に示します。

以上のことを念頭に置いたうえでお読みいただければ幸いです。

実験方法

本解析では、Pythonを用いたデータスクレイピングにより、以下のデータを収集しました。

取得対象:46都道府県すべてにおける評価数100以上の店舗

収集対象:店舗名、評価数、評価点、食べログ店舗会員か否か

対象が食べログ店舗会員かどうかは、店舗ページのトップに写真があるか、店舗側の書いたセールス文章が表示されているかでわかります。

最終的に集まった全6852店舗のデータを用い、解析を行いました。

実験の前に

収集データの確認

まずは、正しくデータが取得できたかを確かめるために、藍屋えん氏がブログ上で展開している大阪府のヒストグラムと同様の図を作成して比較してみます。

前述のブログ上における図と同様に、以下の傾向が確認できます。

- 評価点3.8の前後での分布の変化

- 評価点3.6付近における店舗数のピーク

以上の結果から、本実験では藍屋えん氏が得たものと同じようなデータが収集できていることが確認できました。

食べログ3.8仮説が真の場合の評価点分布

食べログ3.8仮説を検証するためには、仮説が真の場合にどのような評価点の分布になるかを明らかにする必要があります。

今回は、評価点の分布が正規分布(平均 μ = 3.7, 標準偏差 σ = 0.27)であると仮定します。

分布の作成は以下の手順で行いました。

- 評価点の分布のうち、1:4の割合で会員/非会員を分割。その後、非会員を評価点3.8以上/以下で分割し、合計3つの場合に分類した。

- 非会員のうち、評価点が3.8を超える部分を削除。

- 手順2で削除した店舗の評価点がすべて3.6となるように追加。

以上の手順を示した図を以下に示します。

最終的に得られた分布FIg.2(3)は、3.6付近のピークが若干シャープすぎるように思われますが、Fig.1と類似したような分布となっています。

Fig.2(3)を、非会員/会員の割合とともにプロットした図を下に示します。

以上のように、仮に評価点3.8以上の非会員店舗がすべて評価点3.6付近に落とされている場合、評価点3.6付近で非会員の割合が大きく増加することが予想されます。

つまり、食べログ3.8仮説を検証するには、非会員/会員の割合の変化を見る必要があります。

実験結果

各地域ごとの評価点分布

それでは、収集したデータの解析に移ります。

まずは、収集したデータを"北海道、東北","中部", "中国・四国", "関東", "関西", "九州・沖縄"の6種類に分け、それぞれの地域ごとの評価点分布をプロットしました。

Fig.4より、すべての分布で「評価点3.6付近における店舗数のピーク」が存在することが分かります。また、中部地方を除くすべての地域で「評価点3.8の前後での分布の変化」も確認できます。

以上の結果から、藍屋えん氏が発見した一連の傾向は、日本全国の評価点分布に存在することがわかりました。

しかしながら、会員・非会員に分けてみると、食べログ会員店舗の評価点分布にも3.6付近にピークが存在することが分かります。

全国の評価点分布と非会員割合

次は、この分布をすべてまとめた全国の評価点分布と、非会員/会員の割合をプロットした図を見てみます。

Fig.5 からは、食べログ3.8仮説が真だった場合に想定される、評価点3.6付近の非会員割合の増大は確認できないことがわかります。

評価点3.25辺りで非会員割合が増大していますが、これは、この範囲での対象店舗数が少ないことが原因だと思われます。

また、評価点4.0以降では非会員の割合が減少していますが、こちらもそもそも店舗数が少ないため、有意な差であるかを判定することは困難です。

以上の結果より、少なくともインターネット上で公開されているデータだけでは、食べログ3.8仮説を証明することは不可能であることが示唆されます。

まとめ

本記事では、食べログの店舗評価データのスクレイピングにより、以下の食べログ3.8仮説の検証を試みました。

各地域ごとの評価点分布からは、明らかに評価点3.6付近で店舗数の増大が認められました。また、3.8点付近での分布の変化も確認され、藍屋えん氏が発見したこれらの傾向は、全国的に存在することが示されたといえます。

しかしながら、この仮説を証明するためには、食べログ評価点3.6付近において、非会員店舗の数が会員店舗に比較して有意に大きいことを示す必要があります。

そして、今回得られたデータでは、評価点3.6点付近での非会員割合のピークは認められませんでした。

以上の結果より、食べログ3.8仮説は収集したデータからは証明できないことが明らかとなりました。

最後に

最終的には仮説が証明できない、否定的な結果となってしまいましたが、全国的な評価点分布の傾向、そして個別の評価から考えれば、食べログ運営が評価点に何かしら恣意的な操作を加えていることは明らかです。

食べログ曰く、この評価方法は『食通度合い』と言われているようですが……。(現在も用いられているかは不明)

『食べログの点数はどうやって決まる?』い~ちんさんの日記 [食べログ]

この記事を見て、本当にそれだけか? もっと他に隠していることがあるのでは? と勘ぐってしまうのは自然なことです。

皆さん食べログの評価方法に同様な不満を抱いていて、その不満をぴったり可視化してくれる(ように見える)のがあのブログ記事だったのではないでしょうか。

しかしながら、少なくとも、この『食べログ3.8仮説』は今回の解析で存在を証明できないことが明らかになりました。

(陰謀というものはそう簡単に尻尾を出さないものです)

食べログ運営のみなさんが、この不当な風評で苦しむことがないように祈るばかりです。

それでは、長い投稿を最後まで見ていただきありがとうございました。

konkon

追記:

スクレイピングとデータ解析に用いたプログラムをGitHubに置いておきます。

GitHub - konkon3249/tabelog_scraping

自分でもやりたい! という人がいたらどうぞ。